AI基本概念

AI(Artificial Intelligence)是“人工智能”的英文缩写,人工智能是研究如何让计算机系统模拟、延伸和扩展人类智能的学科,核心目标是使机器具备推理、学习、规划和感知等能力。

AI技术分类

按强弱可分为:

弱人工智能(Weak AI / Narrow AI)

仅针对特定任务或领域设计,无法实现跨领域通用能力

当前已广泛应用于语音识别(如Siri)、图像处理(如人脸识别)和推荐系统(如电商平台算法)

依赖机器学习算法,通过海量数据训练实现功能优化,但缺乏自主意识与泛化能力

强人工智能(Strong AI / AGI)

具备与人类相当的通用认知能力,可完成跨领域推理、学习和决策

现阶段尚未实现,全球科研机构仍在探索其技术路径(如类脑计算、神经形态芯片等方向)

需突破的核心挑战包括意识建模、环境适应性及多模态信息整合

超人工智能(Super AI)

理论上的终极形态,智能水平全面超越人类所有认知领域

涉及自我意识生成、创造力突破等前沿领域,目前仅存在于学术探讨阶段

伦理安全与可控性成为该领域研究的核心关注点

总结:当前所有已落地的AI应用(如ChatGPT、自动驾驶系统)均属于弱人工智能范畴。中美等国在强人工智能研发竞赛中差距正加速缩小。

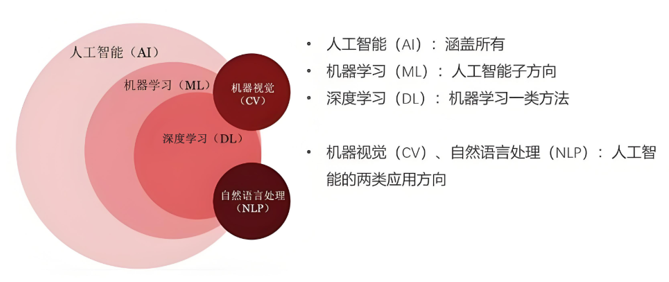

按核心技术可分为:

机器学习(Machine Learning, ML)

定义:通过数据训练模型自动优化性能,无需显式编程。

分类:

监督学习:基于标记数据训练模型(如线性回归、支持向量机);

无监督学习:从无标签数据中发现模式(如聚类算法);

强化学习:通过环境反馈优化策略(如AlphaGo)。

深度学习(Deep Learning, DL)

定义:基于多层神经网络的机器学习分支,擅长处理非结构化数据(文本、图像、语音)。

核心技术:

卷积神经网络(CNN):用于图像识别;

循环神经网络(RNN):处理序列数据(如语音和时间序列);

Transformer架构:支撑大语言模型(LLM)的核心技术。

生成式人工智能(Generative AI, Gen AI)

定义:生成新内容(文本、图像、音频)的技术,如GPT系列和GAN。

应用场景:文本生成、图像合成、对话系统。大语言模型(Large Language Model, LLM)

定义:基于深度学习的大规模语言模型,参数规模达数十亿至万亿级,专攻自然语言处理(NLP)任务。

关键技术:

预训练+微调:在大规模文本数据上预训练,针对特定任务优化;

提示词工程(Prompt Engineering):通过优化输入指令提升模型输出质量;

检索增强生成(RAG):结合外部知识库提升生成准确。

典型应用:文本生成与摘要;

机器翻译与多语言处理;

智能问答与对话系统。

概念关系图